En los últimos meses ha comenzado a circular una técnica de ingeniería social conocida como ClickFix, que utiliza falsos sistemas de verificación tipo captcha para inducir al usuario a ejecutar comandos directamente en Windows.

No se trata de un virus tradicional. No explota una vulnerabilidad crítica. Se basa en algo más simple y más efectivo: lograr que el propio usuario ejecute el ataque. Cuando esto ocurre, pueden aparecer comportamientos anómalos en el equipo, como los descritos en estas señales claras de que tu computadora o celular podría estar comprometido por un ataque digital.

Este artículo explica qué es ClickFix, cómo funciona técnicamente, cómo detectarlo y qué medidas concretas pueden aplicarse para prevenirlo tanto a nivel individual como empresarial, incluyendo prácticas complementarias como habilitar actualizaciones automáticas para reducir la superficie de ataque.

Un poco de historia: de los adjuntos maliciosos a la ejecución voluntaria

Para entender ClickFix, conviene mirar hacia atrás. A inicios de los años 2000, la mayoría de ataques se distribuían mediante archivos adjuntos infectados. El usuario debía abrir un documento o ejecutar un archivo .exe. Luego evolucionaron las macros en documentos Office, que requerían habilitar contenido activo. Más adelante, el phishing se sofisticó hasta imitar perfectamente portales bancarios o sistemas corporativos.

En la última década, el ransomware automatizó el cifrado masivo, explotando vulnerabilidades o credenciales filtradas.

ClickFix representa una nueva etapa en esa evolución: ya no necesita que el usuario descargue un archivo ni que habilite macros. Le pide que ejecute una instrucción directamente en su sistema operativo bajo la apariencia de una verificación legítima.

Es un cambio sutil pero significativo: la acción maliciosa ya no parece sospechosa porque se presenta como parte del proceso normal de navegación.

¿Qué es ClickFix?

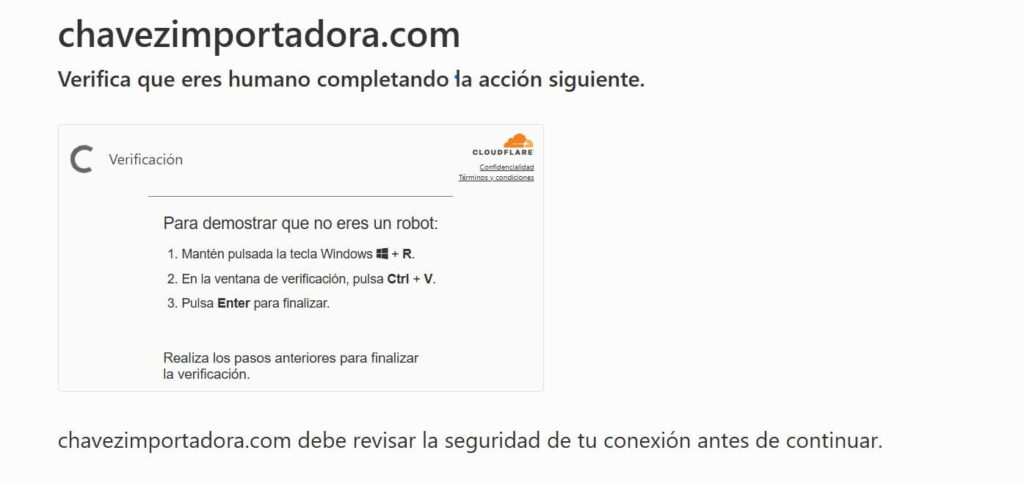

ClickFix es una técnica de ingeniería social que simula un sistema de verificación legítimo —generalmente similar a Cloudflare o reCAPTCHA— y le indica al usuario que debe ejecutar ciertos pasos “para validar que no es un robot”.

Las instrucciones suelen ser:

- Presionar Windows + R

- Pegar un contenido con Ctrl + V

- Presionar Enter

Lo que el usuario no sabe es que el sitio ya copió un comando malicioso al portapapeles mediante JavaScript.

Al pegar y ejecutar, el comando se ejecuta directamente en el sistema operativo.

En otras palabras, el ataque no depende de un exploit técnico, lo que evidencia que medidas como una VPN, aunque útiles, no son suficientes por sí solas frente a la ingeniería social, como explicamos en este análisis sobre seguridad en múltiples capas.

Depende de que el usuario confíe en la instrucción.

¿Qué hace el comando ejecutado?

El contenido puede variar según la campaña, pero normalmente invoca:

- powershell.exe

- cmd.exe

- mshta.exe

- bitsadmin

- curl

El objetivo es descargar y ejecutar un payload remoto, que puede:

- Instalar un loader persistente

- Crear tareas programadas

- Abrir una shell reversa

- Descargar troyanos de acceso remoto

- Preparar el entorno para ransomware

Desde la perspectiva del sistema, la ejecución fue iniciada por el usuario, lo que dificulta la detección temprana si no hay monitoreo avanzado.

Cómo encaja ClickFix en MITRE ATT&CK

ClickFix no es una técnica aislada; combina múltiples tácticas conocidas dentro del framework MITRE ATT&CK:

- T1204 – User Execution

- T1059 – Command and Scripting Interpreter

- T1105 – Ingress Tool Transfer

- T1547 – Boot or Logon Autostart Execution

- T1071 – Application Layer Protocol

Lo innovador no es la técnica individual, sino la forma en que se orquesta mediante manipulación contextual.

Cómo prevenir ClickFix (usuarios individuales)

La prevención comienza con una regla básica:

Ningún captcha legítimo pedirá ejecutar comandos en Windows.

Si un sitio solicita presionar Windows + R y ejecutar algo manualmente, debe asumirse como malicioso.

La acción correcta es cerrar la página inmediatamente y no ejecutar nada.

Si ya se ejecutó el comando:

- Desconectar el equipo de la red.

- Informar al área técnica.

- Cambiar credenciales sensibles.

- Revisar procesos activos.

La velocidad de respuesta es determinante.

Cómo prevenir ClickFix en entornos empresariales

En empresas, la mitigación no puede depender solo del criterio del usuario.

Principio de mínimo privilegio

Si los usuarios no trabajan como administradores locales, el impacto disminuye considerablemente.

Restricción de intérpretes de comandos

- Activar PowerShell Script Block Logging.

- Limitar ExecutionPolicy Bypass.

- Implementar control de aplicaciones.

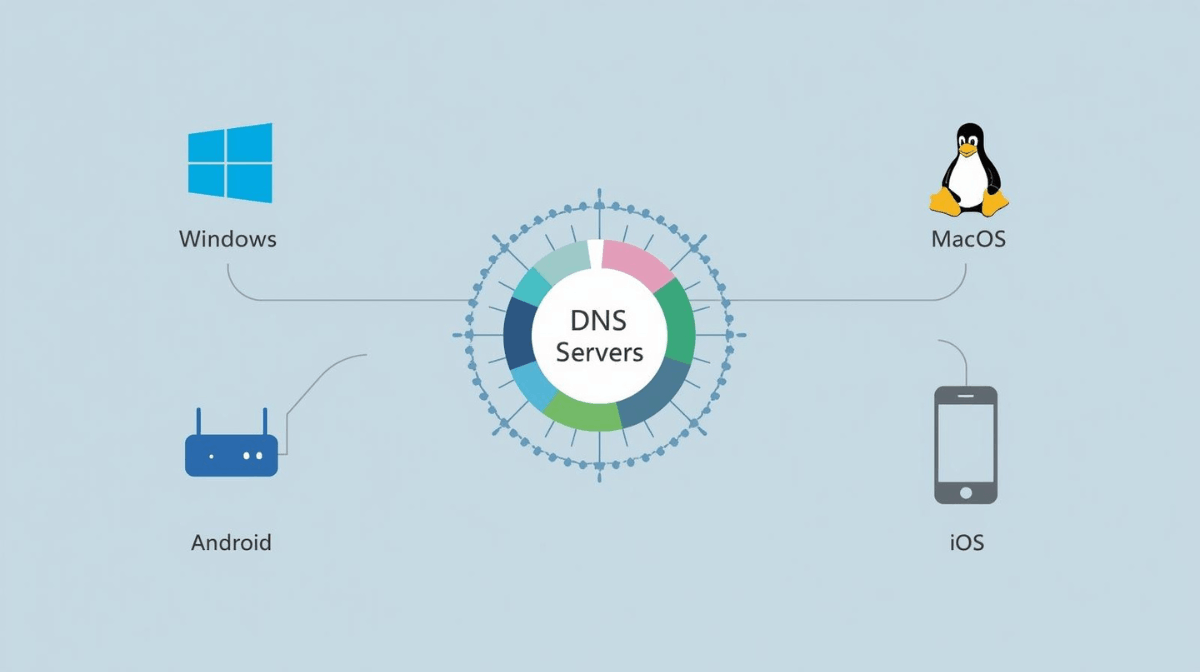

Inspección de tráfico saliente

Muchas variantes requieren descargar payloads externos.

Un firewall con inspección de tráfico puede bloquear la conexión antes de que el ataque se complete.

Arquitecturas empresariales con este enfoque pueden revisarse en

https://www.nettix.com.pe/firewall-empresarial/

Segmentación de red

Si un endpoint se compromete, la segmentación evita que el atacante alcance servidores críticos.

Modelos de VPN y segmentación pueden observarse en

https://www.nettix.com.pe/vpn/

Monitoreo continuo

ClickFix no siempre activa alertas tradicionales de antivirus.

La detección depende de:

- Monitoreo de procesos administrativos.

- Supervisión de tareas programadas nuevas.

- Análisis de tráfico saliente anómalo.

Infraestructuras con monitoreo activo bajo modelos de nube privada mejoran significativamente la capacidad de contención.

Ejemplos de este enfoque pueden revisarse en

https://www.nettix.com.pe/nube-privada/

Conclusión

ClickFix no introduce una nueva vulnerabilidad en Windows. Introduce una nueva narrativa de ataque.

La evolución de la ingeniería social demuestra que, cuando las superficies técnicas se reducen, los atacantes explotan comportamiento.

El desafío ya no es solo bloquear malware. Es diseñar entornos donde una simple combinación de teclas no pueda comprometer la operación.

Comprender esta evolución histórica permite anticipar la siguiente. Como complemento práctico, también puede resultar útil revisar esta comparativa de software de copias de seguridad para fortalecer la resiliencia ante incidentes. Para profundizar en otro de los vectores más utilizados en ataques de ingeniería social, puedes consultar también seguridad del correo electrónico: amenazas clave y cómo proteger el email empresarial.