Cuando escribes una dirección web en tu navegador, das por hecho que llegarás al sitio correcto. Confías en que ese nombre apunta exactamente a ese servidor. El problema es que esa confianza se apoya en un sistema —el DNS— que, si es manipulado, puede llevarte a otro lugar sin que lo notes.

A eso se le conoce como envenenamiento DNS. Y aunque suene técnico, sus efectos son muy concretos y cotidianos: páginas falsas que parecen reales, robo de contraseñas, fraudes bancarios o malware instalado sin que el usuario entienda cómo pasó.

El DNS: una guía que puede ser engañada

El DNS funciona como una agenda de contactos de Internet. Tú preguntas por un nombre de dominio y el sistema te devuelve una dirección IP. Todo ocurre en milisegundos y de forma invisible.

Ese proceso no siempre ocurre desde cero: muchas veces el sistema recuerda respuestas anteriores gracias a la caché DNS, un mecanismo que acelera la navegación, pero que también puede jugar en contra cuando la información ha sido manipulada.

El envenenamiento DNS ocurre cuando un atacante consigue alterar esa respuesta, haciendo que el nombre correcto apunte a una IP controlada por él. El navegador cree que todo está bien, pero en realidad estás entrando a un sitio falso.

Lo peligroso no es solo la redirección, sino que el sitio malicioso suele imitar visualmente al original. El usuario no sospecha y termina ingresando datos sensibles como contraseñas, correos, tarjetas o accesos corporativos.

Por qué este ataque es especialmente peligroso

A diferencia de otros ataques más evidentes, el envenenamiento DNS no siempre muestra señales claras. La página carga, el diseño es familiar y el dominio parece correcto.

En muchos casos, el único indicio es un aviso del navegador relacionado con certificados HTTPS inválidos, errores de seguridad o advertencias que solemos ignorar por costumbre. Cuando eso ocurre, el daño muchas veces ya empezó.

Este tipo de ataque suele combinarse con phishing, malware o robo de sesión, amplificando su impacto.

Qué consecuencias puede tener un DNS envenenado

El riesgo no es teórico. Las consecuencias suelen ser directas:

El robo de credenciales es uno de los efectos más comunes. El atacante obtiene accesos que luego reutiliza en otros servicios. También puede inyectarse malware en el equipo, comprometiendo todo el sistema.

En entornos empresariales, un solo equipo afectado puede servir como puerta de entrada a la red interna. Y en el peor de los casos, se producen fraudes financieros o pérdida de información crítica.

Lo más delicado es que muchas víctimas no se dan cuenta de inmediato de lo ocurrido.

Cómo prevenir el envenenamiento DNS en la práctica

La protección no depende de una sola acción, sino de una combinación de decisiones técnicas y hábitos correctos.

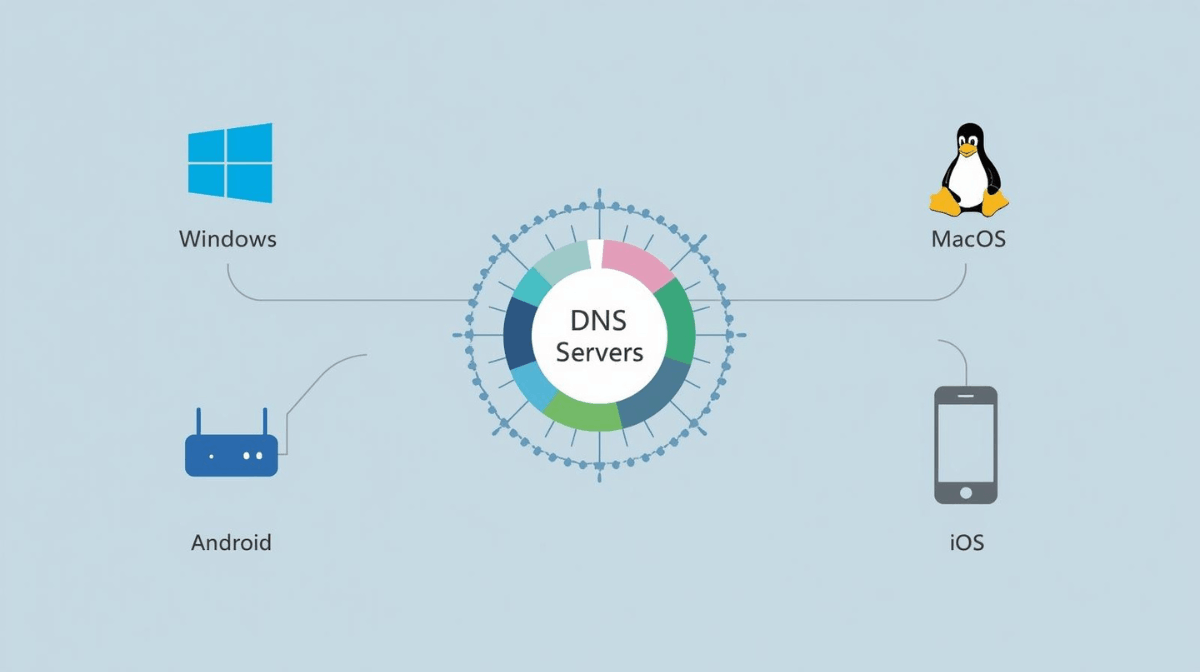

Usar DNS confiables y con enfoque en seguridad

No todos los servidores DNS son iguales. Existen servicios públicos que validan respuestas y bloquean dominios maliciosos conocidos. Usarlos reduce considerablemente el riesgo de respuestas manipuladas.

DNS con validación de seguridad, como los que implementan DNSSEC, añaden una capa extra de protección frente a respuestas falsas.

Entre los más utilizados se encuentran Quad9, que prioriza la seguridad y bloquea automáticamente dominios peligrosos conocidos (9.9.9.9 y 149.112.112.112), y OpenDNS de Cisco, que además de estabilidad permite aplicar políticas de filtrado y protección adicional (208.67.222.222 y 208.67.220.220).

Otra opción muy popular es Cloudflare DNS, conocido por su rapidez y soporte de tecnologías modernas como DNS sobre HTTPS y DNS sobre TLS, lo que dificulta la manipulación del tráfico DNS (1.1.1.1 y 1.0.0.1). Google Public DNS (8.8.8.8 y 8.8.4.4) también es ampliamente utilizado por su fiabilidad, aunque su enfoque está más orientado a disponibilidad que a filtrado de amenazas.

Elegir uno de estos servicios y configurarlo correctamente en el sistema operativo o en el router no elimina todos los riesgos, pero reduce significativamente la probabilidad de recibir respuestas DNS manipuladas, especialmente frente a ataques comunes de envenenamiento o redirección maliciosa.

En muchos casos, protegerse implica dejar de usar el DNS del proveedor y optar por resolvers externos. Esa decisión técnica, conocida como bypass DNS, puede mejorar seguridad, privacidad y control, siempre que se haga con criterio.

Verificar siempre HTTPS y los certificados

Si un navegador muestra advertencias sobre certificados inválidos, conexiones inseguras o dominios sospechosos, no es un detalle menor. Es una de las pocas señales visibles de que algo puede estar mal a nivel DNS o de red.

Introducir datos personales en un sitio con errores de certificado es una de las formas más comunes de caer en este tipo de ataques.

Mantener sistemas y dispositivos actualizados

Muchos ataques DNS se apoyan en equipos desactualizados, routers domésticos mal configurados o dispositivos IoT con contraseñas por defecto.

Actualizar sistemas operativos, firmware de routers, cámaras y dispositivos conectados es una medida básica, pero clave. Un DNS envenenado muchas veces entra por el eslabón más débil de la red.

Segmentar la red y proteger el perímetro

En entornos empresariales, separar redes mediante VLANs, usar firewalls correctamente configurados y limitar qué dispositivos pueden resolver DNS reduce el impacto de un ataque.

No todos los equipos deberían tener el mismo nivel de acceso ni usar los mismos resolvers sin control.

Herramientas que ayudan a prevenir y detectar ataques DNS

La prevención real se apoya en herramientas concretas, no solo en teoría.

Firewalls de red con inspección DNS permiten detectar respuestas anómalas.

Sistemas IDS/IPS pueden alertar sobre comportamientos sospechosos relacionados con resolución de nombres.

Soluciones antispam y antiphishing reducen el riesgo de que un ataque DNS termine en robo de credenciales.

Servicios de monitoreo DNS permiten detectar cambios inesperados en la resolución de dominios críticos.

En entornos profesionales, estas capas trabajan juntas para detectar el problema antes de que el usuario lo note.

Cuando el DNS deja de ser solo “configuración” y pasa a ser estrategia

Elegir un DNS seguro es un buen primer paso, pero en entornos empresariales —o incluso en redes domésticas cada vez más complejas— el DNS deja de ser una simple preferencia técnica y se convierte en parte de la estrategia de seguridad. La correcta implementación, el monitoreo continuo y la integración con firewalls, antispam y sistemas de detección marcan la diferencia entre una red que “funciona” y una red realmente protegida. En ese punto, contar con acompañamiento especializado resulta clave. En Nettix un proveedor de servicios de nube privada, precisamente trabajan sobre esa capa invisible de Internet —DNS, correo, red y seguridad— ayudando a empresas a diseñar infraestructuras más seguras, estables y preparadas para amenazas como el envenenamiento DNS, sin que el usuario final tenga que lidiar con la complejidad técnica.

El futuro del envenenamiento DNS: ataques más silenciosos

Los ataques DNS no están desapareciendo, están evolucionando. Hoy se combinan con análisis automatizado, ataques dirigidos y explotación de dispositivos IoT mal protegidos.

Cámaras, sensores y routers domésticos siguen siendo un vector común. No porque el DNS sea débil, sino porque la red que lo rodea lo es.

La tendencia es clara: ataques más precisos, menos ruidosos y más difíciles de detectar para el usuario promedio.

En conclusión

El envenenamiento DNS no es un problema lejano ni exclusivo de grandes empresas. Afecta a usuarios comunes todos los días, precisamente porque actúa en una capa invisible de Internet.

Protegerse no requiere paranoia, pero sí criterio: usar DNS confiables, respetar las advertencias del navegador, mantener equipos actualizados y no subestimar la seguridad de la red.

En SCI WebHosting insistimos en una idea simple: Cuando Internet te lleva a un lugar “que parece correcto”, no siempre lo es. Y el DNS, cuando es manipulado, es quien mueve el volante sin que lo veas.