El correo electrónico no es solo una herramienta operativa. Es el lugar donde se negocian contratos, se envían estados financieros, se comparten datos personales, se validan transferencias y se toman decisiones que impactan directamente en la reputación y en la continuidad del negocio.

Para un gerente o director, el correo ya no puede verse como un simple canal de comunicación. Es un activo crítico. Y como todo activo crítico, requiere protección proporcional a su valor. Ahí es donde el cifrado de correos deja de ser un asunto técnico y se convierte en una decisión estratégica. De hecho, forma parte de un enfoque más amplio de seguridad del correo empresarial que toda organización debería evaluar a nivel directivo.

El correo como infraestructura invisible del negocio

En muchas organizaciones, el correo funciona “bien” hasta que algo ocurre. Un mensaje interceptado. Un archivo sensible reenviado sin autorización. Una filtración que expone conversaciones internas de meses o incluso años.

Lo que pocos dimensionan es que el correo electrónico concentra información acumulativa. Cada mensaje aislado puede parecer inofensivo, pero juntos forman un mapa completo de clientes, proveedores, procesos internos, negociaciones y vulnerabilidades.

El cifrado no es una capa adicional por lujo. Es una medida de control que asume una realidad: los datos viajan, se almacenan y pueden ser interceptados, y por eso también deben contar con esquemas de respaldo adecuados como los revisados en esta comparativa de software de copias de seguridad. Por eso, además de cifrar, muchas organizaciones incorporan sistemas de detección y prevención de intrusiones (IDS/IPS) para identificar y bloquear accesos no autorizados en tiempo real, como detallamos en ¿Qué es un IDS/IPS y por qué una PYME ya no puede ignorarlo? (https://www.sciwebhosting.com/seguridad/que-es-un-ids-ips-y-por-que-una-pyme-ya-no-puede-ignorararlo/).

¿Qué significa realmente cifrar un correo?

Cifrar un correo electrónico implica transformar su contenido en un formato ilegible para cualquier persona que no posea la clave adecuada para descifrarlo. En términos simples, aunque alguien intercepte el mensaje, no podrá comprenderlo.

La mayoría de los sistemas de cifrado modernos funcionan con criptografía de clave pública. El remitente utiliza una clave pública para cifrar el mensaje y solo el destinatario, con su clave privada, puede leerlo. Además, se pueden incorporar firmas digitales que permiten verificar que el mensaje realmente proviene de quien dice enviarlo.

Para un tomador de decisiones, el punto no es dominar la matemática detrás de la criptografía, sino entender el impacto: confidencialidad, integridad y autenticidad.

Qué información debería cifrarse (y por qué no es opcional)

En entornos empresariales, cualquier información no pública debería considerarse candidata a cifrado. Esto incluye:

– Datos financieros

– Información de clientes

– Datos personales

– Información médica o sensible

– Documentación legal

– Estrategias comerciales

Las regulaciones sobre protección de datos en distintos países ya no son meras recomendaciones. Mantener sistemas actualizados mediante actualizaciones automáticas es parte del mismo enfoque de cumplimiento y reducción de riesgos que impulsa el cifrado. Las multas, sanciones y daños reputacionales por exposición de información pueden superar ampliamente el costo de implementar una política de cifrado adecuada.

Pero incluso más allá de la regulación, está la confianza. Un cliente que percibe debilidad en la protección de datos difícilmente volverá a confiar.

¿De qué amenazas protege el cifrado?

El cifrado de correo electrónico reduce el impacto de múltiples riesgos:

Intercepción en tránsito (ataques tipo “man in the middle”): cuando un tercero intenta capturar el mensaje mientras viaja por la red.

Fraude y manipulación de mensajes: la firma digital permite verificar autenticidad.

Exposición tras brechas internas: si una cuenta es comprometida, el contenido cifrado sigue siendo ilegible sin la clave correspondiente.

Es importante entender que el cifrado no elimina todos los riesgos —por ejemplo, no evita que un usuario envíe información al destinatario equivocado—, pero sí reduce drásticamente el impacto de una intrusión técnica.

TLS, PGP y S/MIME: lo que un director debería saber

Existen distintos niveles y modelos de cifrado. No todos protegen de la misma manera.

TLS: protección en tránsito

TLS (Transport Layer Security) cifra el canal por el cual viaja el correo entre servidores. Es como asegurar la carretera por donde circula el mensaje. Sin embargo, una vez que el mensaje llega al servidor destino, puede almacenarse en texto legible si no se aplican capas adicionales.

TLS es hoy un estándar básico, pero no siempre es suficiente cuando se trata de información altamente sensible.

PGP: modelo descentralizado

PGP (Pretty Good Privacy) utiliza criptografía de clave pública y un modelo de confianza descentralizado. No depende de una autoridad central para validar identidades. Es ampliamente utilizado en entornos donde se requiere mayor autonomía y control.

Requiere configuración y coordinación entre remitente y destinatario, por lo que suele aplicarse en comunicaciones específicas de alta sensibilidad.

S/MIME: modelo con autoridad certificadora

S/MIME también utiliza cifrado de clave pública, pero bajo un modelo centralizado que depende de una autoridad certificadora. Está integrado en muchos clientes empresariales y resulta habitual en entornos corporativos estructurados.

La diferencia clave para un decisor no es técnica, sino de gobernanza: quién controla la confianza y cómo se gestionan las identidades digitales.

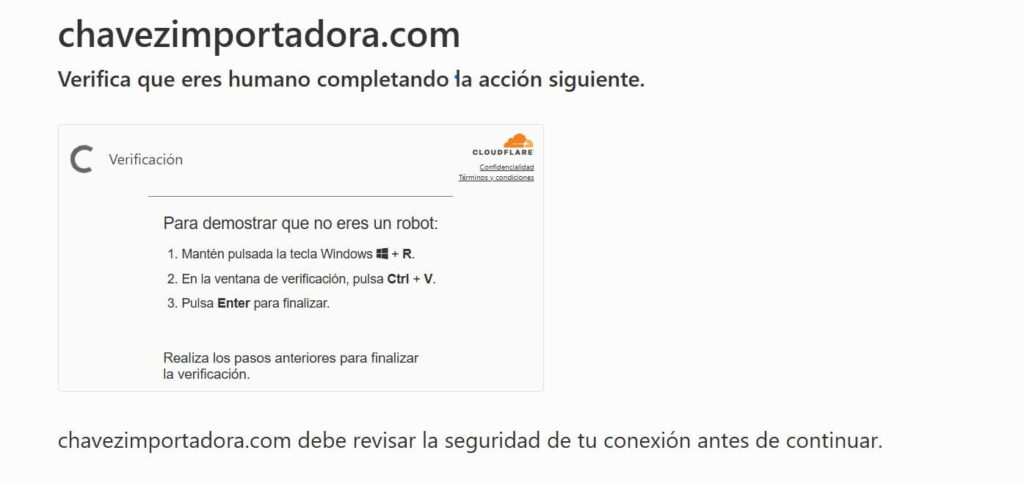

El verdadero riesgo: creer que “no somos objetivo”

Uno de los errores más comunes en comités directivos es asumir que solo las grandes corporaciones son blanco de ataques. La realidad es distinta. Las organizaciones medianas y pequeñas suelen ser más atractivas para atacantes precisamente porque sus controles son más débiles.

El correo electrónico sigue siendo el principal vector de entrada para incidentes de seguridad. Y una vez dentro, el atacante busca información acumulada.

El cifrado no es una solución aislada, pero es una pieza clave dentro de una estrategia más amplia de protección: autenticación robusta, políticas de acceso, monitoreo y formación interna.

Cifrar no es solo proteger datos, es proteger reputación

Cuando ocurre una filtración, el daño no es únicamente técnico. Es financiero y reputacional. Inversionistas, clientes y aliados evalúan la madurez digital de la organización.

Implementar cifrado de correos envía una señal clara: la empresa entiende el valor de la información y actúa en consecuencia.

Para un director general o un CFO, la pregunta no debería ser si el cifrado es complejo, sino cuánto costaría no tenerlo cuando ocurra el incidente inevitable.

Una decisión de liderazgo

El cifrado de correos no es un lujo tecnológico ni una moda. Es una práctica básica de gobierno digital responsable.

Las empresas que integran la seguridad desde la estrategia —y no como reacción a una crisis— construyen resiliencia. En un entorno donde la información es poder, protegerla no es opcional.

La confidencialidad ya no es solo un asunto técnico. Es una decisión de liderazgo. Para profundizar en cómo esta visión aplica también a los entornos web, puede consultarse Certificado SSL explicado para directivos: riesgos, diferencias y lo que sí importa hoy.